ВОПРОС 1

Случа́йное собы́тие — подмножество множества исходов случайного эксперимента; при многократном повторении случайного эксперимента частота наступления события служит оценкой его вероятности.

Классификация событий

Различают события совместные и несовместные. События называются совместными, если наступление одного из них не исключает наступления другого. В противном случае события называются несовместными. Например, подбрасываются две игральные кости. Событие  — выпадание трех очков на первой игральной кости, событие

— выпадание трех очков на первой игральной кости, событие  — выпадание трех очков на второй кости.

— выпадание трех очков на второй кости.  и

и  — совместные события. Пусть в магазин поступила партия обуви одного фасона и размера, но разного цвета. Событие

— совместные события. Пусть в магазин поступила партия обуви одного фасона и размера, но разного цвета. Событие  — наудачу взятая коробка окажется с обувью черного цвета, событие

— наудачу взятая коробка окажется с обувью черного цвета, событие  — коробка окажется с обувью коричневого цвета,

— коробка окажется с обувью коричневого цвета,  и

и  — несовместные события.

— несовместные события.

Событие называется достоверным, если оно обязательно произойдет в условиях данного опыта.

Событие называется невозможным, если оно не может произойти в условиях данного опыта. Например, событие, заключающееся в том, что из партии стандартных деталей будет взята стандартная деталь, является достоверным, а нестандартная — невозможным.

Событие называется возможным, или случайным, если в результате опыта оно может появиться, но может и не появиться. Примером случайного события может служить выявление дефектов изделия при контроле партии готовой продукции, несоответствие размера обрабатываемого изделия заданному, отказ одного из звеньев автоматизированной системы управления.

События называются равновозможными, если по условиям испытания ни одно из этих событий не является объективно более возможным, чем другие. Например, пусть магазину поставляют электролампочки (причем в равных количествах) несколько заводов-изготовителей. События, состоящие в покупке лампочки любого из этих заводов, равновозможны.

Важным понятием является полная группа событий. Несколько событий в данном опыте образуют полную группу, если в результате опыта обязательно появится хотя бы одно из них. Например, в урне находится десять шаров, из них шесть шаров красных, четыре белых, причем пять шаров имеют номера.  — появление красного шара при одном извлечении,

— появление красного шара при одном извлечении,  — появление белого шара,

— появление белого шара,  — появление шара с номером. События

— появление шара с номером. События  образуют полную группу совместных событий.

образуют полную группу совместных событий.

Введем понятие противоположного, или дополнительного, события. Под противоположным событием  понимается событие, которое обязательно должно произойти, если не наступило некоторое событие

понимается событие, которое обязательно должно произойти, если не наступило некоторое событие  . Противоположные события несовместны и единственно возможны. Они образуют полную группу событий. Например, если партия изготовленных изделий состоит из годных и бракованных, то при извлечении одного изделия оно может оказаться либо годным — событие

. Противоположные события несовместны и единственно возможны. Они образуют полную группу событий. Например, если партия изготовленных изделий состоит из годных и бракованных, то при извлечении одного изделия оно может оказаться либо годным — событие  , либо бракованным — событие

, либо бракованным — событие  .

.

Пространство элементарных событий — множество Ω {\displaystyle \Omega }  всех различных исходов случайного эксперимента.

всех различных исходов случайного эксперимента.

ВОПРОС 4

Различают события зависимые и независимые. Два события называются независимыми, если появление одного из них не изменяет вероятность появления другого. Например, если в цехе работают две автоматические линии, по условиям производства не взаимосвязанные, то остановки этих линий являются независимыми событиями.

Пример 3. Монета брошена два раза. Вероятность появления "герба" в первом испытании (событие A) не зависит от появления или не появления "герба" во втором испытании (событие B). В свою очередь, вероятность появления "герба" во втором испытании не зависит от результата первого испытания. Таким образом, события

Aи Bнезависимые.

Несколько событий называются независимыми в совокупности, если любое из них не зависит от любого другого события и от любой комбинации остальных.

События называются зависимыми, если одно из них влияет на вероятность появления другого. Например, две производственные установки связаны единым технологическим циклом. Тогда вероятность выхода из строя одной из них зависит от того, в каком состоянии находится другая. Вероятность одного события B, вычисленная в предположении осуществления другого события A, называется условной вероятностью события Bи обозначается P{B|A}.

Условие независимости события Bот события Aзаписывают в виде

P{B|A}=P{B}, а условие его зависимости — в виде P{B|A}≠P{B}

Пример 4. В ящике находятся 5 резцов: два изношенных и три новых. Производится два последовательных извлечения резцов. Определить условную вероятность появления изношенного резца при втором извлечении при условии, что извлеченный в первый раз резец в ящик не возвращается.

Решение. Обозначим Aизвлечение изношенного резца в первом случае, а A¯ извлечение нового. Тогда P{A}=25, P{A¯¯¯¯}=1−25=35. Поскольку извлеченный резец в ящик не возвращается, то изменяется соотношение между количествами изношенных и новых резцов. Следовательно, вероятность извлечения изношенного резца во втором случае зависит от того, какое событие осуществилось перед этим.

Обозначим Bсобытие, означающее извлечение изношенного резца во втором случае. Вероятности этого события могут быть такими:

P{B|A}=14, P{B|A¯¯¯¯}=24=12.

Следовательно, вероятность события Bзависит от того, произошло или нет событие A.

ВОПРОС 6

Теорема сложения вероятностей формулируется следующим образом.

Вероятность суммы двух несовместимых событий равна сумме вероятностей этих событий:

Докажем теорему сложения вероятностей для схемы случаев. Пусть возможные исходы опыта сводятся к совокупности случаев, которые мы для наглядности изобразим в виде n точек:

Предположим, что из этих случаев  благоприятны событию

благоприятны событию  , а

, а  – событию

– событию  . Тогда

. Тогда

Так как события  и

и  несовместимы, то нет таких случаев, которые благоприятны и

несовместимы, то нет таких случаев, которые благоприятны и  , и

, и  вместе. Следовательно, событию

вместе. Следовательно, событию  благоприятны

благоприятны  случаев и

случаев и

Подставляя полученные выражения в формулу (3.2.1), получим тождество. Теорема доказана.

ВОПРОС 7

Если событие А может произойти только при выполнении одного из событий  , которые образуют полную группу несовместных событий, то вероятность события А вычисляется по формуле

, которые образуют полную группу несовместных событий, то вероятность события А вычисляется по формуле

.

.

Эта формула называется формулой полной вероятности.

Вновь рассмотрим полную группу несовместных событий  , вероятности появления которых

, вероятности появления которых  . Событие А может произойти только вместе с каким-либо из событий

. Событие А может произойти только вместе с каким-либо из событий  , которые будем называть гипотезами. Тогда по формуле полной вероятности

, которые будем называть гипотезами. Тогда по формуле полной вероятности

Если событие А произошло, то это может изменить вероятности гипотез  .

.

По теореме умножения вероятностей

,

,

откуда

.

.

Аналогично, для остальных гипотез

Полученная формула называется формулой Байеса (формулой Бейеса)

Пример: Имеются три одинаковые урны. В первой урне находятся 4 белых и 7 черных шаров, во второй – только белые и в третьей – только черные шары. Наудачу выбирается одна урна и из неё наугад извлекается шар. Какова вероятность того, что этот шар чёрный?

Решение: рассмотрим событие  – из наугад выбранной урны будет извлечён чёрный шар. Данное событие может произойти в результате осуществления одной из следующих гипотез:

– из наугад выбранной урны будет извлечён чёрный шар. Данное событие может произойти в результате осуществления одной из следующих гипотез:

– будет выбрана 1-я урна;

– будет выбрана 1-я урна;

– будет выбрана 2-я урна;

– будет выбрана 2-я урна;

– будет выбрана 3-я урна.

– будет выбрана 3-я урна.

Так как урна выбирается наугад, то выбор любой из трёх урн равновозможен, следовательно:

Обратите внимание, что перечисленные гипотезы образуют полную группу событий, то есть по условию чёрный шар может появиться только из этих урн, а например, не прилететь с бильярдного стола. Проведём простую промежуточную проверку:

, ОК, едем дальше:

, ОК, едем дальше:

В первой урне 4 белых + 7 черных = 11 шаров, по классическому определению:

– вероятность извлечения чёрного шара при условии, что будет выбрана 1-я урна.

– вероятность извлечения чёрного шара при условии, что будет выбрана 1-я урна.

Во второй урне только белые шары, поэтому в случае её выбора появления чёрного шара становится невозможным:  .

.

И, наконец, в третьей урне одни чёрные шары, а значит, соответствующая условная вероятность извлечения чёрного шара составит  (событие достоверно).

(событие достоверно).

По формуле полной вероятности:

– вероятность того, что из наугад выбранной урны будет извлечен чёрный шар.

– вероятность того, что из наугад выбранной урны будет извлечен чёрный шар.

Ответ:

ВОПРОС 8

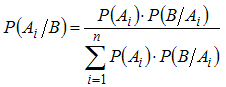

Пусть событие  происходит одновременно с одним из

происходит одновременно с одним из  несовместных событий

несовместных событий  . Требуется найти вероятность события

. Требуется найти вероятность события  , если известно, что событие

, если известно, что событие  произошло.

произошло.

На основании теоремы о вероятности произведения двух событий можно написать

Откуда

или

Формула носит название формулы Байеса.

Пример. Три организации представили в контрольное управление счета для выборочной проверки. Первая организация представила 15 счетов, вторая — 10, третья — 25. Вероятности правильного оформления счетов у этих организаций известны и соответственно равны: 0,9; 0,8; 0,85. Был выбран один счет и он оказался правильным. Определить вероятность того, что этот счет принадлежит второй организации.

Решение. Пусть  — события выбора счета у первой, второй и третьей организаций. Соответствующие вероятности будут

— события выбора счета у первой, второй и третьей организаций. Соответствующие вероятности будут

,

,  ,

,

По формуле полной вероятности определяем вероятность выбора правильно оформленного счета

По формуле Байеса находим исходную вероятность

.

.

ВОПРОС 9

При решении вероятностных задач часто приходится сталкиваться с ситуациями, в которых одно и тоже испытание повторяется многократно и исход каждого испытания независим от исходов других. Такой эксперимент еще называется схемой повторных независимых испытаний или схемой Бернулли.

Примеры повторных испытаний:

1) многократное извлечение из урны одного шара при условии, что вынутый шар после регистрации его цвета кладется обратно в урну;

2) повторение одним стрелком выстрелов по одной и той же мишени при условии, что вероятность удачного попадания при каждом выстреле принимается одинаковой (роль пристрелки не учитывается).

Итак, пусть в результате испытания возможны два исхода: либо появится событие А, либо противоположное ему событие. Проведем n испытаний Бернулли. Это означает, что все n испытаний независимы; вероятность появления события $А$ в каждом отдельно взятом или единичном испытании постоянна и от испытания к испытанию не изменяется (т.е. испытания проводятся в одинаковых условиях). Обозначим вероятность появления события $А$ в единичном испытании буквой $р$, т.е. $p=P(A)$, а вероятность противоположного события (событие $А$ не наступило) - буквой $q=P(\overline{A})=1-p$.

Тогда вероятность того, что событие А появится в этих n испытаниях ровно k раз, выражается формулой Бернулли

Pn (k)= Ckn ⋅ pk ⋅ qn − k, q =1− p.

Распределение числа успехов (появлений события) носит название биномиального распределения.

ВОПРОС 12

Числовые характеристики случайных величин

Математическое ожидание. Математическим ожиданием дискретной случайной величины Х, принимающей конечное число значений хi с вероятностями рi, называется сумма:

(6 а)

(6 а)

Математическим ожиданием непрерывной случайной величины Х называется интеграл от произведения ее значений х на плотность распределения вероятностей f (x):

(6 б)

(6 б)

Несобственный интеграл (6 б) предполагается абсолютно сходящимся (в противном случае говорят, что математическое ожидание М (Х) не существует). Математическое ожидание характеризует среднее значение случайной величины Х. Его размерность совпадает с размерностью случайной величины.

Свойства математического ожидания:

(7)

(7)

Дисперсия. Дисперсией случайной величины Х называется число:

(8)

(8)

Дисперсия является характеристикой рассеяния значений случайной величины Х относительно ее среднего значения М (Х). Размерность дисперсии равна размерности случайной величины в квадрате. Исходя из определений дисперсии (8) и математического ожидания (5) для дискретной случайной величины и (6) для непрерывной случайной величины получим аналогичные выражения для дисперсии:

(9)

(9)

Здесь m = М (Х).

Свойства дисперсии:

(10)

(10)

Среднее квадратичное отклонение:

(11)

(11)

Так как размерность среднего квадратичного отклонения та же, что и у случайной величины, оно чаще, чем дисперсия, используется как мера рассеяния.

Моменты распределения. Понятия математического ожидания и дисперсии являются частными случаями более общего понятия для числовых характеристик случайных величин – моментов распределения. Моменты распределения случайной величины вводятся как математические ожидания некоторых простейших функций от случайной величины. Так, моментом порядка k относительно точки х 0 называется математическое ожидание М (Х – х 0) k. Моменты относительно начала координат х = 0 называются начальными моментами и обозначаются:

(12)

(12)

Начальный момент первого порядка есть центр распределения рассматриваемой случайной величины:

(13)

(13)

Моменты относительно центра распределения х = m называются центральными моментами и обозначаются:

(14)

(14)

Из (7) следует, что центральный момент первого порядка всегда равен нулю:

(15)

(15)

Центральные моменты не зависят от начала отсчета значений случайной величины, так как при сдвиге на постоянное значение С ее центр распределения сдвигается на то же значение С, а отклонение от центра не меняется: Х – m = (Х – С) – (m – С).

Теперь очевидно, что дисперсия – это центральный момент второго порядка:

(16)

(16)

Асимметрия. Центральный момент третьего порядка:

(17)

(17)

служит для оценки асимметрии распределения. Если распределение симметрично относительно точки х = m, то центральный момент третьего порядка будет равен нулю (как и все центральные моменты нечетных порядков). Поэтому, если центральный момент третьего порядка отличен от нуля, то распределение не может быть симметричным. Величину асимметрии оценивают с помощью безразмерного коэффициента асимметрии:

(18)

(18)

Знак коэффициента асимметрии (18) указывает на правостороннюю или левостороннюю асимметрию (рис. 2).

Рис. 2. Виды асимметрии распределений.

Эксцесс. Центральный момент четвертого порядка:

(19)

(19)

служит для оценки так называемого эксцесса, определяющего степень крутости (островершинности) кривой распределения вблизи центра распределения по отношению к кривой нормального распределения. Так как для нормального распределения  , то в качестве эксцесса принимается величина:

, то в качестве эксцесса принимается величина:

(20)

(20)

На рис. 3 приведены примеры кривых распределения с различными значениями эксцесса. Для нормального распределения Е = 0. Кривые, более островершинные, чем нормальная, имеют положительный эксцесс, более плосковершинные – отрицательный.

Рис. 3. Кривые распределения с различной степенью крутости (эксцессом).

Моменты более высоких порядков в инженерных приложениях математической статистики обычно не применяются.

Мода дискретной случайной величины – это ее наиболее вероятное значение. Модойнепрерывной случайной величиныназывается ее значение, при котором плотность вероятности максимальна (рис. 2). Если кривая распределения имеет один максимум, то распределение называется унимодальным. Если кривая распределения имеет более одного максимума, то распределение называется полимодальным. Иногда встречаются распределения, кривые которых имеют не максимум, а минимум. Такие распределения называются антимодальными. В общем случае мода и математическое ожидание случайной величины не совпадают. В частном случае, для модального, т.е. имеющего моду, симметричного распределения и при условии, что существует математическое ожидание, последнее совпадает с модой и центром симметрии распределения.

Медиана случайной величины Х – это ее значение Ме, для которого имеет место равенство:  т.е. равновероятно, что случайная величина Х окажется меньше или больше Ме. Геометрически медиана – это абсцисса точки, в которой площадь под кривой распределения делится пополам (рис. 2). В случае симметричного модального распределения медиана, мода и математическое ожидание совпадают.

т.е. равновероятно, что случайная величина Х окажется меньше или больше Ме. Геометрически медиана – это абсцисса точки, в которой площадь под кривой распределения делится пополам (рис. 2). В случае симметричного модального распределения медиана, мода и математическое ожидание совпадают.

ВОПРОС 13

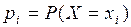

На первый взгляд может показаться, что для задания дискретной случайной величины достаточно пере-

перечислить все ее возможные значения. В действительности

это не так: случайные величины могут иметь одинако-

одинаковые перечни возможных значений, а вероятности их —

различные. Поэтому для задания дискретной случайной

величины недостаточно перечислить все возможные ее

значения, нужно еще указать их вероятности.

Законом распределения дискретной случайной величины называют соответствие между возможными значениями и

их вероятностями; его можно задать таблично, аналити-

аналитически (в виде формулы) и графически.

При табличном задании закона распределения дискрет-

дискретной случайной величины первая строка таблицы содержит

возможные значения, а вторая — их вероятности:

X xtxt... хп

Р PiPt '•• Рп

Приняв во внимание, что в одном испытании случайная

величина принимает- одно и только одно возможное зна-

значение, заключаем, что события X — xlt X = xa,..., X = хп

образуют полную группу; следовательно, сумма вероят-

вероятностей этих событий, т. е. сумма вероятностей второй

строки таблицы, равна единице:

Если множество возможных значений X бесконечно

(счетно), то ряд р1-\-р1 +... сходится и его сумма равна

единице.

Пример. В денежной лотерее выпущено 100 билетов. Разыгры-

Разыгрывается один выигрыш в 50 руб. и десять выигрышей по 1 руб. Найти

закон распределения случайной величины X — стоимости возможного

выигрыша для владельца одного лотерейного билета'.

Решение. Напишем возможные значения X: *1 = 50, хг—\,

х3 = 0. Вероятности этих возможных значений таковы: р1 = 0,01,

р„ = 0,01, Рз=1-(р1 + Р4)=0,89.

Напишем искомый закон распределения:

X 50 100

р 0,01 0,1 0,89

ВОПРОС 14

Как уже отмечалось, дискретная случайная величина может быть задана перечнем всех ее возможных значений и их вероятностей. Такой способ неприменим для непрерывных случайных величин, так как невозможно составить перечень всех возможных значений, заполняющих интервал (a,b). В связи с этим вводится понятие функции распределения вероятностей случайной величины, пригодное как для дискретной, так и для непрерывной случайной величины.

Пусть x – действительное число. Вероятность события, состоящего в том, что X примет значение, меньшее x, т.е. вероятность события  , обозначим через

, обозначим через  . Разумеется, если x изменяется, то, вообще говоря, изменяется и

. Разумеется, если x изменяется, то, вообще говоря, изменяется и  , т.е.

, т.е.  есть функция x.

есть функция x.

Функцией распределения называют функцию  , определяющую вероятность того, что случайная величина X в результате испытания примет значение, меньшее x:

, определяющую вероятность того, что случайная величина X в результате испытания примет значение, меньшее x:

Геометрически это равенство можно истолковать так:  есть вероятность того, что случайная величина примет значение, которое изображается на числовой оси точкой, лежащей левее x.

есть вероятность того, что случайная величина примет значение, которое изображается на числовой оси точкой, лежащей левее x.

Рассмотрим по-отдельности случаи дискретной и непрерывной случайной величин.

1. Дискретная случайная величина. Рассмотрим функцию распределения  дискретной случайной величины

дискретной случайной величины  , принимающей значения

, принимающей значения  .

.

ü Если  , то

, то  , так как в этом случае событие

, так как в этом случае событие  является невозможным.

является невозможным.

ü Если  , то событие

, то событие  наступит тогда и только тогда, когда наступит событие

наступит тогда и только тогда, когда наступит событие  , поэтому

, поэтому

.

.

ü Если  , то событие

, то событие  равно сумме событий

равно сумме событий  и

и  и

и

.

.

ü Аналогично, если  , то

, то  .

.

Таким образом, функция распределения случайной дискретной величины равна  , где

, где  , и суммирование производится по тем

, и суммирование производится по тем  , для которых

, для которых  .

.

Таким образом, в точках  функция распределения испытывает скачки.

функция распределения испытывает скачки.

2. Непрерывная случайная величина. В отличие от случая дискретной случайной величины в данном случае  пробегает все непрерывное множество значений, а сама функция

пробегает все непрерывное множество значений, а сама функция  возрастает монотонно.

возрастает монотонно.

Если вероятность события  равна

равна  , а вероятность события

, а вероятность события  равна

равна  , то вероятность того, что случайная величина

, то вероятность того, что случайная величина  заключена между

заключена между  и

и  равна разности соответствующих значений функции распределения:

равна разности соответствующих значений функции распределения:  .

.

Вероятность того, что непрерывная случайная величина X примет одно определенное значение, равна нулю. Имеет смысл рассматривать лишь вероятность попадания ее в некоторый интервал, пусть даже и сколь угодно малый.

График функции распределения для дискретной случайной величины представляет собой ступенчатую разрывную функцию, а непрерывной –монотонно возрастающую непрерывную функцию.

Пример. Пусть среднедушевой доход в у.е. описывается функцией распределения

где  . Какова вероятность того, что в случайно выбранной семье среднедушевой доход меньше 200 у.е.? Вероятность того, что среднедушевой доход лежит в пределах от 50 до 150 у.е.? Ответ: а)

. Какова вероятность того, что в случайно выбранной семье среднедушевой доход меньше 200 у.е.? Вероятность того, что среднедушевой доход лежит в пределах от 50 до 150 у.е.? Ответ: а)  , б) 0,534.

, б) 0,534.